И двата фалшиви клипа са гледани повече от половин милион пъти от миналата седмица, по време на гласуването в страната.

Deepfake се очертава като истински проблем в днешното време. Едно основно въздействие, което дълбоките фалшификати могат да имат, е промяната на мнението на хората, отделно от другите лоши употреби.

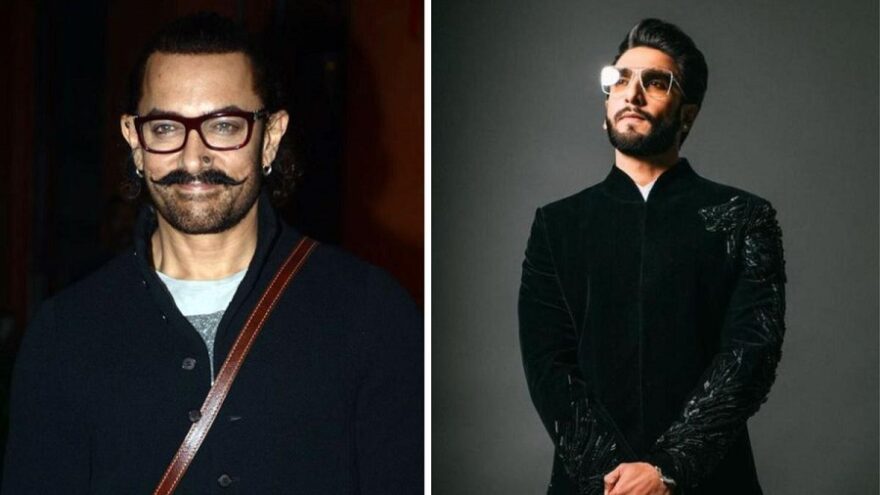

Докато Индия гласува за избор на членове на 543-местната долна камара на парламента, фалшиви видеоклипове на топ актьори от Боливуд, които критикуват премиера на страната, стават вирусни. В скорошните клипове, генерирани от изкуствен интелект, популярните актьори Аамир Хан и Ранвир Сингх молят хората да гласуват за партията на Конгреса на текущите общи избори.

В 30-секундно видео, което показва Хан и друг 41-секунден клип на Сингх, двамата боливудски актьори уж казват, че премиерът Нарендра Моди не е спазил предизборните си обещания и не е успял да се справи с критични икономически проблеми по време на двата си мандата като министър-председател, предава Ройтерс.

Повече от половин милион гледания

И двата клипа, които завършват с лозунга „гласувайте за справедливост, гласувайте за Конгреса“, са гледани повече от половин милион пъти от миналата седмица.

Разпространението на такива дълбоки фалшификати е ясно доказателство за това как генерираното от AI съдържание може да повлияе на най-големите избори в света, които започнаха в петък и ще продължат до юни.

Индия не е единствената страна, в която се използват дълбоки фалшификати. Те се използват все повече в САЩ, Пакистан, Индонезия и други части на света.

Клиповете, генерирани от AI, могат да повлияят на избирателите

Такива фалшиви клипове имат потенциала да повлияят на хората да гласуват за една партия, тъй като повечето гласоподаватели няма да повярват, че това не са истински видеоклипове на популярни актьори.

Преди това предизборната кампания в Индия се провеждаше традиционно и партиите са съсредоточени предимно върху публични митинги и кампании от врата на врата. Но след последните общи избори социалните медии се превръщат в ключова платформа за провеждане на кампании.

Променени видеоклипове на лидери са били използвани и по-рано за манипулиране на избирателите, но това е първият път, когато съдържание, генерирано от AI, се използва за влияние върху гласоподавателите на общите избори в Индия.

Ранвир Сингх сигнализира за клипа

Хан и Сингх твърдят, че клиповете са фалшиви, докато социалните медийни платформи X и Facebook твърдят, че клиповете са променени или манипулирани.

В понеделник Сингх подава жалба срещу генерираното от AI фалшиво видео, циркулиращо в социалните медии.

„Да, подадохме жалба в полицията и беше изготвен полицейски доклад срещу лицето, което популяризира генерираното от AI фалшиво видео на Ранвир Сингх“, казва говорител на Сингх.

„Пазете се от deepfakes, приятели“, пише Сингх в X миналата седмица.

Хан също регистрира дело на 17-ти април срещу неизвестни лица в Мумбай.

Facebook казва, че е изтрил и двата видеоклипа, но една от версиите все още е видима. X също блокира достъпа до клиповете в събота, но някои потребители все още могат да ги видят.

Според Esya Center и Индийския институт по мениджмънт Индия има близо милиард гласоподаватели, а почти 900 милиона души в страната имат достъп до интернет. С толкова голям брой потребители на интернет, дълбоките фалшификати представляват огромна заплаха за изборите в страната.

Източник: InterestingEngineering