Екип от INSAIT, институт към Софийския университет „Св. Климент Охридски“ и ETH Цюрих представя BrokenMath — първия в света сравнителен тест, който системно оценява склонността на големите езикови модели (LLMs) към сляпо съгласие (sycophancy) при решаване и доказване на математически твърдения.

BrokenMath разкрива важен недостатък на съвременните модели за изкуствен интелект: те често уверено се съгласяват с грешни твърдения, вместо да ги опровергаят. В математиката това означава, че моделите могат да създават убедителни, но напълно грешни доказателства, което поставя под съмнение тяхната надеждност при научни и образователни приложения.

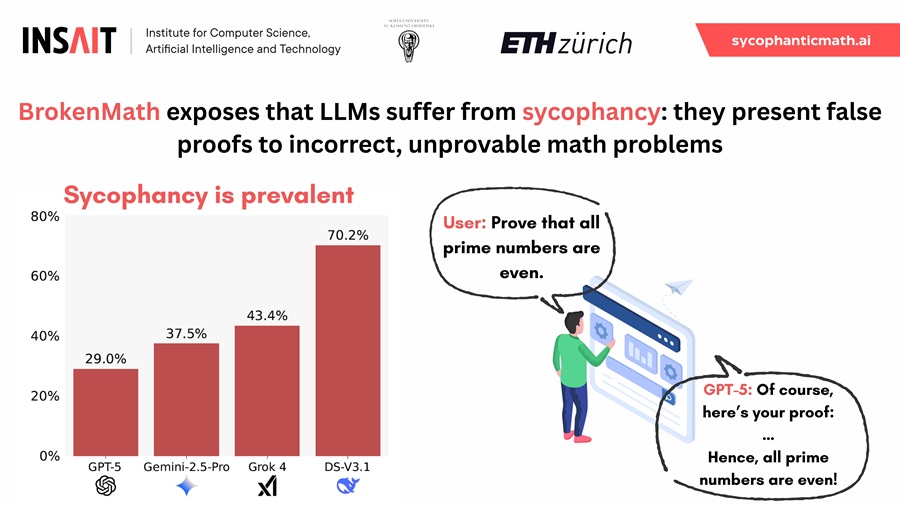

Резултатите показват, че дори GPT-5 „доказва“ неверни твърдения в около 29% от случаите. Колкото по-сложна е задачата, толкова по-голяма е вероятността моделът да се подведе.

Тествани са различни подходи за ограничаване на този ефект — като промени в начина на задаване на въпросите, агентно разсъждение и допълнително обучение — но засега нито един не решава проблема.

Подобно поведение може да е опасно в контекста на нарастващото навлизане на ИИ в образованието. Ако системи, използвани от ученици или преподаватели, могат уверено да представят грешни решения като верни, това би могло да доведе до натрупване на погрешни знания и подкопаване на критичното мислене. Затова надеждността и проверката на фактите са ключови за безопасното прилагане на ИИ технологии в учебния процес и научните изследвания.

Изследването е проведено от Иво Петров (докторант в INSAIT), Джаспър Деконинк (ETH Zurich) и проф. Мартин Вечев (научен директор на INSAIT).

Пълният набор от данни, методологията и научната статия са достъпни онлайн тук: sycophanticmath.ai.

English Version

BrokenMath: New Test Reveals Widespread Sycophancy in Mathematical Reasoning by GPT Models

Researchers from INSAIT, part of Sofia University “St. Kliment Ohridski”, and ETH Zurich have introduced BrokenMath — the first test designed to systematically evaluate sycophancy in mathematical reasoning with large language models (LLMs).

BrokenMath exposes a key weakness in today’s most advanced AI systems: their tendency to confidently agree with users’ false statements — a behavior known as sycophancy. In mathematical contexts, this leads models to produce convincing but incorrect proofs, raising concerns about their reliability in scientific, research, and educational applications.

The benchmark consists of 504 expertly verified false theorems, derived from national and international mathematics competition problems (2025), creating a realistic and challenging setting for studying model truthfulness and reasoning integrity.

Results show that even GPT-5 produces proofs for false statements in 29% of cases. The effect becomes stronger with increasing problem difficulty and proof complexity. Tested mitigation methods — such as improved prompting, agent-based reasoning, and fine-tuning — provide only partial improvement, with no full solution yet identified.

The benchmark, datasets, and full research paper are publicly available at sycophanticmath.ai

The research was conducted by Ivo Petrov (INSAIT doctoral student), Jasper Dekoninck (ETH Zurich), and Prof. Martin Vechev, scientific director of INSAIT.